又是OpenAI。这家公司于2022年11月推出的AI聊天机器人程式ChatGPT惊艳世界,引领了大语言模型和生成式AI(Generative AI)产业的蓬勃发展。而在2月16日,该公司的文本到视频(text-to-video)AI模型Sora横空出世,再次吸引了全世界的目光。

各种狂热的预测接连不断,不同程度的惊叹、忧虑、赞扬与失望也纷纷而至。但毫无疑问的是,如果单从输出效果来看,OpenAI的Sora是迄今为止最令人印象深刻的视频扩散模型(video diffusion model)。比起Runway的Gen-2和Pika等已公开的类似AI工具,Sora在从文本到视频的生成能力上有了飞跃式的提升。

包括部分影视行业从业者在内的不少人认为,Sora的出现标志着一个新的里程碑,将会极大地冲击以好莱坞为标杆的全球影视行业。而业内权威媒体《综艺》(Variety)则为这股热潮注入了一剂冷却剂,称Sora还远不能“取代”好莱坞。

“Sora确实在生成逼真内容方面取得了巨大的成就,可以在高端娱乐(high-end entertainment)中发挥作用。但如今,创作者仍然要求对表演和场景拥有完全的控制权,所以视频扩散模型离它们能够真的生成好莱坞影视内容,还有很长的路要走,” AI公司Metaphysic的首席执行官兼创始人汤姆·格雷厄姆(Tom Graham)对《综艺》的记者说。该公司通过AI技术,让汤姆·汉克斯(Tom Hanks)在米拉麦克斯影业的新片《这里》(Here)中成功“减龄”,也因此备受业界瞩目。

Sora的先进体现在哪里?

Sora与Runway和Pika等其他视频扩散模型工具所提供的功能基本相同,主要聚焦于视频生成和视频编辑。其中包括基于文本提示(text prompt)生成新的短视频,基于2D图像生成视频(例如,使图像动画化),修复(替换或插入新的视觉元素)和扩展(将镜头延伸到其原始框架之外,并用相关内容填充)。

但Sora在以下三个方面实现了突破:

一是视频质量和逼真度。与其他模型的输出片段相比,Sora生成的视频图像保真度明显更高,整体质量也明显更好,而且还能围绕同一主体实现远景、中景、近景、特写等不同镜头的切换。在Sora公布的几个视频示例中,有一段栩栩如生的史前猛犸象影像,几乎完美体现其文本提示的场景:“几只巨大的、毛茸茸的猛犸象,踩着白雪皑皑的地面走近,风吹动它们身上的长长毛发,远处是白雪覆盖的高大树木和雄伟山脉,午后的光线营造出温暖的光芒”。

Sora生成的猛犸象群视频截图

二是视频的长度。Sora的视频输出可以长达一分钟,同时保持与文本提示的一致性。而在其发布之前被认为是业内领先的Runway的Gen-2,在2023年8月的更新中仅仅可以生成最长18秒的视频,8月之前的视频输出时长只有4秒。

三是时空一致性。通过让模型一次接受多帧画面并进行学习和分析,Sora可以解决“确保主体即使暂时消失在视野之外也保持不变”的问题,由此带来了延长生成的视频长度的可能性。重复使用相同的提示措辞或条件参数进行生成,永远不会得到相同的结果,这是生成式AI自带的特性。因此Sora的这种“扩展”功能可以从一个输出到下一个输出实现人物角色或对象的连续性,从而让生成更长的AI叙事成为可能,在理论上为那些想要创建由多段视频拼接而成的AI生成式影片的人解决了痛点。

这些改进的出现是基于两大技术革新——时空补丁(Spacetime Patch)技术和扩散型Transformer(Diffusion Transformer,简称DiT)架构。它们让Sora超越了单纯的视频生成模型。正如OpenAI公司所说,Sora的研发目标是成为一个“世界模拟器”(world simulator),通过对真实世界的模拟,实现像人类一样的、对世界全面而准确的“认知”。而OpenAI也发现,随着训练计算量的增加,Sora输出的视频样本质量会得到提高,现已具备模拟现实世界某些属性的能力。

Sora要被实际应用到影视行业

还有哪些阻碍?

首先是连贯性和一致性的问题。虽然前面提到Sora已经可以模拟现实世界的某些属性,但很明显,Sora对物理规则的“理解”还不够透彻。例如,在一段演示视频中,装着红色液体、即将坠落的玻璃杯还未破裂,液体已经洒了一桌;在另一段视频中,一个人在跑步机上锻炼,然而跑步的方向是错误的;还有一段视频跟踪蚂蚁在巢穴内的爬行,仔细观察,不难发现视频中的蚂蚁只有四条腿……

Sora的“玻璃杯碎裂效果”视频演示

其次是可控性。正如前文中Metaphysic的首席执行官汤姆·格雷厄姆所说,创作者,尤其是好莱坞的创作者们,需要百分百的掌控度。到目前为止,无论是Sora还是其他生成式AI工具,都没能为创作者提供足够的控制条件和精确度以推导和掌控它们的输出效果。这意味着在短期内,AI工具其实会比传统的工具和方法更加受限。虽然随着新的控制参数被逐渐添加进来,情况似乎有所好转,但这些改进的效果也并不大。

更重要的是版权问题。在版权法和生成式AI各个层面的使用都有更清晰的概念和规章制度之前,好莱坞的制片厂和制作人们几乎不可能在大小荧幕上真正使用这些输出成品。许多问题仍然悬而未决,包括由AI辅助的这些模型是否受版权法保护,以及AI生成的内容是否因模型很可能在受版权保护的材料上进行训练而构成侵权责任。

去年2月,美国版权局重新审查并撤销了对漫画《Zarya of the Dawn》的版权保护,因为其中包含Midjourney创建的图片

目前,Sora并未对公众开放使用,且还需经过红队测试(Red teaming)以确定潜在的漏洞或滥用途径。OpenAI还承诺,将收集来自全球政策制定者、教育工作者和艺术家的反馈,以了解他们的关切点,并确定什么才是有益的使用场景。

这与Google研究人员在一月底发布文字到视频AI模型Lumiere时的担忧不谋而合,他们表示,虽然这种工具在创意和创作方面提供了可能性,但“存在滥用技术创造虚假或有害内容的风险。”

生成式AI

将如何开启影视制作的新时代?

《综艺》的资深记者认为,尽管还存在着无法忽视的缺陷,生成式AI及其基础模型已经体现出了在合成制作(synthetic production)方面的潜力,这将取代部分实体制作的传统方式。其中,三个方面的能力最值得关注。

第一,视频生成:包括Sora、Runway的Gen-2和Pika在内的基于视频扩散模型的工具能够合成新鲜的视频,从文本提示、图像或视频中创建短的、无声的动态影像。这也是科技巨头们追逐的风口之一,Facebook和Google的研究人员分别开发了具有类似功能的未公开模型,分别命名为Emu Video和Imagen Video。此外,Google推出的多模态模型Gemini预计将提供视频生成功能,而OpenAI则有望在今年晚些时候通过其GPT-5模型更新,为ChatGPT引入视频生成功能。

Gemini 1.5迅速识别出Sora演示视频由AI生成,并分析指出了其中不合理的地方

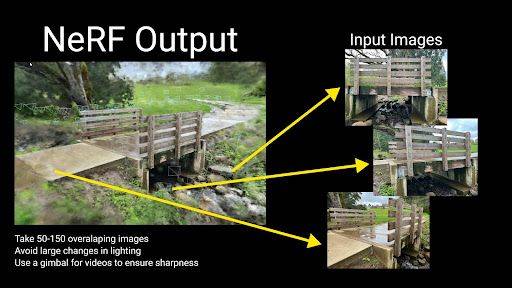

第二,神经辐射场(Neural Radiance Field,简称NeRF)。在娱乐产品的制作领域,神经辐射场因其在视觉效果(VFX)方面的能力而备受关注。简单来说,它可以通过一部分2D图像推断出未见视角,即未被包含在训练数据中的视角,生成主体对象或场景的高保真3D图像。

与3D建模常用的摄影测量法相比,神经辐射场还能保留并动态渲染所有的反射、光照和不同材质的特性,例如玻璃的透明性、金属的光泽、人皮肤的光泽等。

对于VFX从业者甚至是导演们而言,单个神经辐射场可以呈现任意数量的可视化3D内容,可以在云服务器中操作,并能以各种可编辑的3D格式导出;它还能作为“虚拟摄像机”,使创作者能够模拟无限的“镜头”移动路径,从任何角度或位置进行构图,从而实现在后期重新定义场景构图的可能性;此外,在当下的虚拟制作中,需要视觉特效工作人员利用虚幻引擎(Unreal Engine)等渲染出逼真的场景环境3D影像同步到LED墙体上,而通过神经辐射场则能更轻松、更低成本地完成3D场景的创建,只需提前派出一小队摄影师前往场地简单地捕捉环境的视频或图像,然后进行渲染。

半导体行业巨头英伟达(NVIDIA)的神经辐射场3D场景创作演示

第三,影视分身。目前,利用Synthesia、Soul Machines和HeyGen等公司开发的生成式AI工具可以创建完全合成的、逼真的“分身”,结合深度伪造(Deepfake)视频和合成语音技术,精确复制特定人物的外貌、声音、表情和举止。这些独特的AI分身有时也被称为数字人、孪生体、替身或克隆人。

在语音能力方面,可以为这些分身提供它们可以口述的文本;也可以通过与GPT-4等大语言模型为它们提供知识库甚至是“大脑”,从而实现对话上的实时交互以及定制它们的“个性”。

然而,在当前的技术发展下,AI分身在逼真度上仍有很大的差异,有些几乎无法辨别是否为真人,而其他一些则看起来像3D图形或“游戏化”的人。

特别是,许多AI分身的动作和面部表情还受到技术限制,整体上容易陷入到“恐怖谷”(uncanny valley)的状态中,即会让观众对非常接近但不完全相似的人形或动物形象产生不安和排斥的情感反应。

恐怖谷理论图解(来源:维基百科)

随着技术的进步,也许在未来的某一天,通过在基于真人采集的数据或者在全新的虚拟人上进行训练,可以让完全合成、逼真的AI分身跨越恐怖谷,从而在外观、语言和行为上与现实世界中的人物无法区分开来。

但在包括AI开发人员在内的许多人看来,合成人物的表演不太可能完全取代电影和电视中的真实人类表演,至少它们无法担任主演。除了技术伦理和观众偏好的影响之外,业界普遍认为,要真实地复制人类演员的全部情感和反应能力是极其困难的。

此外,思考深度、情感倾向、个人意志等主观色彩浓烈的因素,体现了创作者的艺术水平,构成了影视作品的鲜明特色和风格,而这些恰恰是生成式AI并不具备的。因此,在未来的几年内,我们也许会看到它们能取代某些重复性较高、技术含量较低的工种,简化制作流程,压缩制作时间;但要进入到影视作品创作的核心领域,它们还有很长的路要走,或许永远也无法到达。